El Higgs y el Grid. Buscando una aguja en un pajar

Dar con el elusivo bosón ha sido enormemente complicado y una pieza esencial para ello ha sido un nuevo sistema de computación

Se suele comparar la caza del bosón de Higgs con la búsqueda de una aguja en un pajar. En ambos casos es necesario escudriñar una enorme cantidad de paja para poder dar con lo que buscamos. Sin embargo, encontrar al elusivo bosón ha sido enormemente más complicado. En primer lugar debemos producir la aguja. En los aceleradores de partículas podemos convertir pura energía en masa y viceversa gracias a la equivalencia masa-energía que Einstein formuló con su famosa ecuación E=mc2. Este truco nos permite materializar como por arte de magia al furtivo bosón. Desafortunadamente, este no vive lo suficiente como para contarlo. Es extremadamente inestable -su efímera vida dura menos de una trillonésima de segundo- y se desintegra inmediatamente. Por suerte, el rastro que deja en forma de partículas estables, como fotones o electrones, nos permite poner de manifiesto su fugaz existencia.

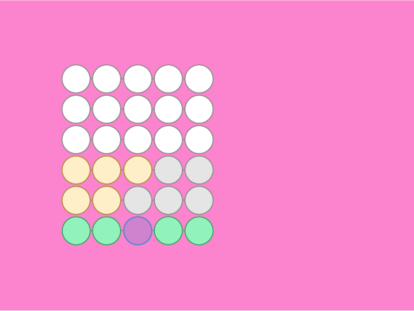

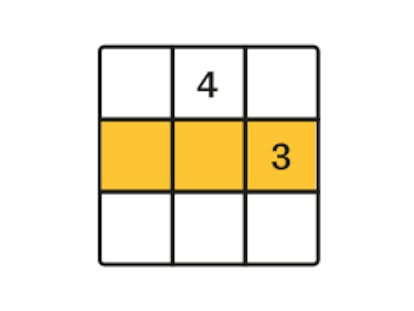

Por otro lado, al producir la aguja inevitablemente se produce también una gran cantidad de paja. Aproximadamente solo en una de cada billón de colisiones originadas por el Large Hadron Collider (LHC) del CERN se puede llegar a producir y detectar el ansiado bosón. Este es muy masivo, y para tener la posibilidad de generarlo es necesario acelerar y colisionar protones a energías enormes que habían sido inalcanzables hasta la fecha. Cada colisión de protones genera cientos de partículas cuyas trayectorias y energías quedan registradas en los detectores. Entre esa maraña de colisiones y partículas se esconde el bosón fugitivo.

Para complicar aún más las cosas, el rastro que deja tras de sí el bosón de Higgs es muy parecido a las señales que producen en nuestro detector otras colisiones más mundanas pero más abundantes. En realidad, la aguja que buscamos no es tal, sino una brizna de paja de determinadas características que se confunde fácilmente con el resto de la paja. Aquí entra en juego otra vez la magia de la mecánica cuántica: su naturaleza probabilística. Los físicos de partículas, como buenos jugadores de dados, podemos calcular con precisión la frecuencia con la que se producen aquellas colisiones que mimetizan la señal característica que dejaría el esquivo bosón. Un exceso significativo respecto al número de señales esperado producidas por los procesos de fondo es un signo inequívoco de la visita relámpago del famoso bosón.

A lo largo del último año, el LHC ha sido capaz de producir 700 billones de colisiones, suficientes como para que el tímido bosón asome la cabeza. Poniendo un símil, este increíble número de colisiones es equivalente al número de granos de arena de playa que caben en una piscina olímpica. El número de bosones producidos equivaldría a tan solo una pizca de esta arena. El rendimiento del acelerador ha ido mejorando con el tiempo por encima de las expectativas iniciales, llegando a alcanzar una intensidad máxima de 500 millones de colisiones por segundo. Cada colisión se registra como una sucesión de impulsos eléctricos en algunos de los cerca de 100 millones de sensores del detector, cual fotografía tomada por una gigantesca cámara digital de 20 metros y 10.000 toneladas de peso que es capaz de fotografiar millones de veces por segundo. Un sistema electrónico ultrarrápido descarta en tiempo real el 99,999% de las colisiones, solo almacenándose en soporte magnético unas 500 por segundo para su posterior análisis. Aún así, el volumen de datos acumulados durante un año se eleva a millones de gigabytes.

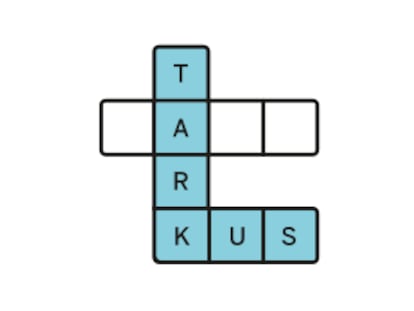

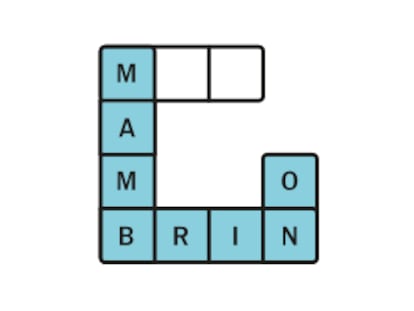

Para almacenar, procesar y analizar tal ingente cantidad de datos ha sido necesario desarrollar y poner en funcionamiento una innovadora infraestructura de computación, el llamado Worldwide LHC Computing Grid. El WLCG es una colaboración global que une centros de computación de todo el mundo a través de Internet usando redes de gran ancho de banda, unas mil veces más rápidas que las que nos llevan Internet hasta nuestras casas. Los datos y los programas de análisis discurren vertiginosos por esta red. El Grid de computación de LHC tiene una capacidad actual de almacenamiento de 200 petabytes (millones de gigabytes) y 300.000 procesadores. España aporta el 5% de los recursos con centros en Barcelona (PIC, Universidad de Barcelona e IFAE), Madrid (CIEMAT, Universidad Autónoma), Valencia (IFIC), Santander (IFCA), Oviedo y Santiago de Compostela.

La necesidad brutal de recursos de computación necesarios para la explotación científica de los datos tomados por los experimentos del LHC condujo a finales de los años noventa del siglo pasado a un grupo de científicos, inspirados en la fiabilidad, ubicuidad y fácil acceso de la red eléctrica, a diseñar y desarrollar un nuevo paradigma de computación, el llamado Grid de computación distribuida, que permitiera integrar, compartir y acceder a través de Internet a recursos heterogéneos de computación geográficamente distribuidos. A diferencia de la web, inventada en el CERN en 1989, en este caso no se trata de acceder únicamente a información, sino a la capacidad de cálculo y almacenamiento de millones de ordenadores que existen en la actualidad conectados a Internet.

Cuando hacemos uso de la electricidad, no nos preocupamos de cómo se generó ni de cómo se distribuye. Simplemente conectamos el enchufe y la usamos. De manera análoga, el Grid hace posible el acceso fácil, transparente y uniforme a recursos de computación distribuidos por todo el planeta. Este modo de computación ha transcendido las fronteras de la ciencia. Ha evolucionado en lo que se conoce como Cloud Computing, o computación en la nube, y grandes corporaciones, como Amazon, ofrecen servicios de pago de acceso a sus recursos de computación en la nube.

El Grid de LHC ha sido una pieza esencial en el descubrimiento de una nueva partícula elemental anunciado por el CERN el pasado 4 de julio. Ha permitido que el análisis de los datos se haya producido con una rapidez vertiginosa. El Grid ha hecho a la vez las funciones de pajar y de trillo y gracias a él hemos podido encontrar la aguja.

José María Hernández Calama es investigador del CIEMAT y miembro del experimento CMS del acelerador LHC.